Seit November 2022 ist ChatGPT in der Schweiz verfügbar. Bereits nach 5 Tagen konnte der ehemalige OpenAI-Chef Sam Altman vermelden, dass sich mehr als eine Million Nutzer:innen registriert hätten. Die Einführung von ChatGPT setzte etablierte Techfirmen unter Druck. Google wurde vorgeworfen, den Anschluss zu verpassen. Mit Bard legte der Konzern aus Mountain View rasch nach. Auch Microsoft, als Grossinvestor an OpenAI beteiligt, veröffentlichte mit Bing Chat und kürzlich Copilot für M365 eigene KI-Assistenten.

Hinter ChatGPT und vergleichbaren Werkzeugen steht ein sogenanntes LLM, ein Large Language Model. Dies ist vereinfacht gesagt eine Wahrscheinlichkeitsverteilung für Wortfolgen. Solche grossen Sprachmodelle verfügen über Milliarden von Parametern und wurden mit riesigen Datenmengen trainiert. Dank Spracherkennung und maschinellem Lernen sind LLMs in der Lage, sprachbasiert und menschenähnlich zu kommunizieren.

Zugang zu Wissen neu gedacht

LLM-Tools wie ChatGPT eröffnen ganz neue Möglichkeiten beim Zugang zu Wissen. Sowohl intern für Mitarbeitende als auch extern auf den eigenen Onlineplattformen, zum Beispiel als Chatbot für Einwohnerinnen und Einwohner. Vorbei sind die Zeiten der mühsamen Suche nach dem richtigen Thema und der gewünschten Information. Dank LLM-Sprachfähigkeiten können komplexe Fragen automatisiert und in natürlicher Sprache beantwortet werden.

Unproblematisch ist das bei öffentlich verfügbaren Informationen wie zum Beispiel Angaben, die sowieso auf der Website einer Verwaltung veröffentlicht sind. Kritischer wird es, wenn eine LLM-basierte Suche in einer internen Wissensdatenbank durchgeführt werden soll.

Datenschutz beim Einsatz von LLMs als interne Wissensdatenbank

Oft stellen sich dabei Fragen zum Datenschutz. Da die Eingaben bei vielen kommerziellen Anbietern zum weiteren Training der Modelle verwendet werden, ist die Verwendung von internen und sensitiven Informationen meist nicht möglich. In Italien wurde ChatGPT im März 2023 nach einer Intervention der Datenschutzbehörde sogar kurzzeitig ganz gesperrt. Medienberichten zufolge blockieren auch einzelne Schweizer Unternehmen den Zugang zu ChatGPT für ihre Mitarbeitenden. Die meisten haben jedoch mit Richtlinien auf das neue KI-Tool reagiert, die sicherstellen sollen, dass keine sensitiven und kundenbezogene Daten eingegeben werden – so auch Abraxas.

Der Wunsch nach 100 % datenschutzkonformer KI-Unterstützung inklusive der Anbindung von Unternehmensdaten bringt auch neue Player auf den Markt. So lancierte das Schweizer Startup AlpineAI mit SwissGPT eine Möglichkeit, ChatGPT zu nutzen, ohne dass sensitive Daten die Schweiz verlassen. Spannende Optionen bietet auch die Möglichkeit, ChatGPT von OpenAI aus der Azure-Cloud von Microsoft in der Schweiz zu beziehen.

Chatbots als 24/7-Onlineschalter

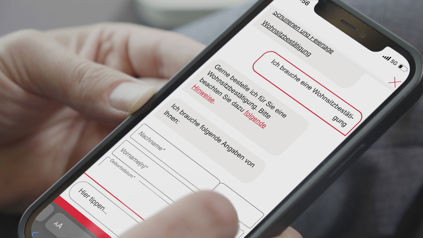

Auch der Abraxas CHATBOT setzt auf KI-Technologie. Angesichts einer stetig wachsenden Bevölkerung und erhöhten Serviceansprüchen stehen öffentliche Verwaltungen vor wachsenden Herausforderungen. Chatbots etablieren sich dabei als wirkungsvolles Tool, um Mitarbeitende von Routineanfragen zu entlasten und der Bevölkerung einen 24/7-Zugang zu Dienstleistungen der Verwaltung zu ermöglichen.

Die neuste Generation des digitalen Verwaltungsassistenten von Abraxas nutzt modernste LLM-Modelle für die automatisierte Antwortgenerierung. Die Integration dieser KI-Technologien reduziert den Administrationsaufwand für Verwaltungen drastisch und steigert gleichzeitig die Antwortqualität für Nutzerinnen und Nutzer signifikant. In der Beantwortung der Fragen ist der Chatbot dabei auf vorgängig klar spezifizierten Inhalte beschränkt, und Felder, die zum Beispiel bei der Bestellung einer Wohnsitzbestätigung eine Eingabe sensitiver Informationen vorsehen, werden ohne LLM-Einsatz ausgewertet.